- 인공지능(Artificial Intelligence, AI)*은 인간의 지능을 모방하여 컴퓨터나 기계가 학습, 추론, 문제 해결, 이해 등의 작업을 수행할 수 있도록 하는 기술을 의미합니다. AI는 다양한 기술과 접근 방식을 통해 복잡한 문제를 해결하며, 특히 데이터 기반의 분석과 결정을 수행하는 데 강력한 도구로 자리 잡고 있습니다.

인공지능의 주요 분야

- 기계 학습(Machine Learning, ML):

- 인공지능의 하위 분야로, 데이터에서 패턴을 학습하여 미래의 결과를 예측하거나 새로운 데이터를 분류하는 기술입니다. 지도 학습, 비지도 학습, 강화 학습과 같은 여러 가지 접근법이 있으며, 딥러닝(Deep Learning)이 ML의 한 갈래로 특히 주목받고 있습니다.

- 딥러닝(Deep Learning):

- 다층 신경망을 사용하여 데이터에서 고차원적인 패턴을 학습하는 기법입니다. 특히 이미지 인식, 음성 인식, 자연어 처리 등 복잡한 문제에서 탁월한 성능을 발휘합니다. 딥러닝은 주로 대량의 데이터를 처리하는 데 매우 효과적입니다.

- 자연어 처리(Natural Language Processing, NLP):

- 인간의 언어를 이해하고 생성하는 AI 기술로, 챗봇, 음성 인식, 번역 등 다양한 응용 프로그램에서 사용됩니다. 최근에는 GPT나 BERT와 같은 모델이 NLP 분야에서 많은 혁신을 이루었습니다.

- 컴퓨터 비전(Computer Vision):

- AI가 이미지나 비디오를 분석하여 객체를 인식하거나 상황을 이해할 수 있게 하는 기술입니다. 자율 주행, 얼굴 인식, 의료 이미지 분석 등 다양한 분야에서 활용됩니다.

- 강화 학습(Reinforcement Learning):

- 에이전트가 환경과 상호작용하며 보상(reward)을 최대화하기 위한 행동을 학습하는 방식입니다. 게임, 로보틱스, 자율주행 등에서 사용됩니다.

인공지능의 주요 기술

- 인공신경망(Artificial Neural Networks, ANN):

- 인간의 뇌 신경 구조를 모방한 수학적 모델입니다. 여러 개의 뉴런(neuron)들이 층(layer)으로 구성되어 있으며, 각 뉴런은 입력을 받아 가중치(weight)를 곱한 후 활성화 함수(activation function)를 거쳐 다음 뉴런으로 전달합니다. 이 과정을 통해 데이터에서 패턴을 학습하게 됩니다.

- 학습 알고리즘:

- 기계 학습과 딥러닝은 학습 알고리즘에 의존합니다. 가장 기본적인 알고리즘으로는 선형 회귀(linear regression), 결정 트리(decision tree), K-최근접 이웃(K-Nearest Neighbors, KNN), 서포트 벡터 머신(SVM) 등이 있으며, 딥러닝에서는 경사 하강법(Gradient Descent)을 이용하여 최적의 모델을 학습합니다.

- 대량의 데이터와 연산 능력:

- AI는 대량의 데이터에서 패턴을 추출하는 것이 매우 중요합니다. 이를 처리하기 위해 GPU 같은 강력한 하드웨어와 클라우드 컴퓨팅 환경이 필요합니다. 많은 양의 데이터를 처리하고 학습하는 과정을 통해 인공지능은 점점 더 정교해집니다.

인공지능의 응용 분야

- 자율주행 자동차:

- 인공지능이 차량을 제어하고 주행 중인 도로 상황을 실시간으로 인식하여 자율적으로 운행할 수 있도록 합니다. 컴퓨터 비전과 딥러닝 기술이 중요한 역할을 합니다.

- 의료 분야:

- AI는 질병 진단, 이미지 분석, 약물 개발 등에서 혁신적인 역할을 하고 있습니다. 특히 딥러닝 기반의 의료 이미지 분석은 암과 같은 복잡한 질병을 조기에 진단하는 데 유용합니다.

- 음성 인식 및 가상 비서:

- 자연어 처리(NLP) 기술을 사용하여 음성을 텍스트로 변환하거나, 질문에 대답하고 명령을 수행하는 AI 시스템이 발전하고 있습니다. 예를 들어, Siri, Google Assistant, Alexa 같은 가상 비서가 이에 해당합니다.

- 추천 시스템:

- AI는 사용자 데이터 분석을 통해 개인에게 맞는 제품, 콘텐츠, 광고 등을 추천합니다. 예를 들어, 넷플릭스, 아마존, 유튜브 등은 사용자의 시청 또는 구매 이력을 바탕으로 맞춤형 추천 시스템을 제공합니다.

- 게임 AI:

- AI는 알파고 같은 기계가 복잡한 게임 전략을 학습하고 인간과 대결할 수 있는 수준까지 발전했습니다. 강화 학습을 통해 AI는 스스로 게임을 플레이하며 최적의 전략을 찾아냅니다.

인공지능의 장점

- 자동화 및 효율성:

- 반복적이고 복잡한 작업을 자동화함으로써 인간의 개입 없이도 효율적으로 처리할 수 있습니다.

- 데이터 기반 의사결정:

- AI는 대량의 데이터를 분석하여 의미 있는 인사이트를 도출하며, 이를 기반으로 의사결정을 내리는 데 도움을 줍니다.

- 문제 해결 능력:

- 복잡한 문제나 인간이 해결하기 어려운 문제에 대해서도 빠르게 솔루션을 제시할 수 있습니다.

인공지능의 한계 및 문제점

- 데이터 의존성:

- AI는 대량의 데이터에 의존합니다. 잘못된 데이터나 편향된 데이터로 학습하면 잘못된 결론을 도출할 수 있습니다.

- 투명성 문제:

- AI 모델이 매우 복잡해지면서, 결과가 왜 그렇게 나왔는지 설명하기 어려운 경우가 많습니다. 이를 블랙박스 문제라고 하며, 특히 딥러닝 모델에서 자주 발생합니다.

- 윤리적 문제:

- AI의 발전과 사용이 개인의 프라이버시 침해, 일자리 감소, AI의 오용 등 윤리적 문제를 야기할 수 있습니다. AI의 개발과 사용에 대한 규제와 윤리적 기준이 필요합니다.

미래의 인공지능

AI는 현재에도 많은 산업에서 혁신적인 변화를 이끌고 있지만, 앞으로는 더 강력한 AI 시스템이 등장할 것으로 예상됩니다. 예를 들어, 자율 지능 시스템, 범용 인공지능(AGI)이 연구되고 있으며, 이는 특정 문제를 해결하는 AI가 아닌, 인간과 비슷한 수준으로 다양한 문제를 해결할 수 있는 인공지능을 목표로 하고 있습니다.

결론

인공지능은 빠르게 발전하고 있으며, 다양한 산업에서 활용되면서 인간의 삶과 업무에 큰 변화를 가져오고 있습니다. 데이터를 기반으로 문제를 해결하고, 반복적인 작업을 자동화하며, 인간과 상호작용할 수 있는 인공지능은 앞으로도 더 많은 혁신을 이끌 것으로 기대됩니다.

지능의 4가지 특성

- 적응적

- 학습 능력

- 선행지식 활용

- 문화 특수적

1. 스피어만의 지능이론 (Spe

arman's Two-Factor Theory of Intelligence)

- 찰스 스피어만(Charles Spearman)*은 지능에 대한 초기 연구자로, 지능을 두 가지 요소로 나누어 설명한 이론을 제안했습니다. 이를 2요인설(Two-Factor Theory)이라고도 합니다.

주요 개념

- g 요인 (일반 지능, General Intelligence): 스피어만은 모든 인지적 과제를 해결하는 데 필요한 공통적인 능력이 있다고 주장했습니다. 이를 "g 요인"이라고 하며, 이 요인은 사람의 학습 능력, 문제 해결, 추론과 같은 다양한 지적 활동에서 영향을 미칩니다.

- s 요인 (특수 지능, Specific Abilities): 각 과제에 따라 요구되는 특수한 능력입니다. 예를 들어, 수학 문제를 풀기 위한 능력과 언어를 이해하는 능력은 서로 다릅니다. 이러한 능력은 특정한 과제나 상황에 특화된 지능으로 정의됩니다.

스피어만의 이론에 따르면, 모든 지능적 활동은 g 요인과 s 요인의 결합으로 설명될 수 있으며, 사람은 공통적인 일반 능력(g 요인)과 과제별로 특화된 능력(s 요인)을 가지고 있습니다.

평가

스피어만의 g 요인은 이후 많은 지능 연구에서 기초가 되었으나, 지능을 단일한 요소로 설명하는 것이 지능의 복잡성을 충분히 반영하지 못한다는 비판도 받았습니다.

2. 가드너의 다중지능이론 (Gardner's Theory of Multiple Intelligences)

- 하워드 가드너(Howard Gardner)*는 인간의 지능을 하나의 지능이 아닌, 여러 가지 독립적인 지능으로 나누어 설명했습니다. 이는 각 개인이 다양한 방식으로 지능을 발휘할 수 있음을 강조하는 이론입니다.

주요 개념

- 다중지능: 가드너는 인간의 지능을 다음과 같은 여덟 가지로 나누었습니다. 각 지능은 독립적이며, 사람들은 여러 지능을 다양한 정도로 가지고 있다고 주장합니다.

- 언어 지능 (Linguistic Intelligence): 말하고 글을 쓰는 능력, 언어를 효과적으로 사용하는 능력.

- 논리-수학 지능 (Logical-Mathematical Intelligence): 논리적 사고 및 수학적 문제 해결 능력.

- 공간 지능 (Spatial Intelligence): 공간적 관계를 인식하고 조작하는 능력.

- 음악 지능 (Musical Intelligence): 음악적 패턴을 인식하고 창작하는 능력.

- 신체-운동 지능 (Bodily-Kinesthetic Intelligence): 신체를 효과적으로 사용하는 능력, 운동과 관련된 지능.

- 대인관계 지능 (Interpersonal Intelligence): 다른 사람들과의 관계에서 감정을 이해하고 상호작용하는 능력.

- 내적 지능 (Intrapersonal Intelligence): 자기 자신을 이해하고 감정을 관리하는 능력.

- 자연지능 (Naturalist Intelligence): 자연을 인식하고 이해하는 능력, 생물학적 환경과 관련된 지능.

가드너는 각 지능이 독립적이므로, 개인마다 특정 지능에서 강점을 보일 수 있으며, 전통적인 지능검사로는 이러한 다양한 지능을 모두 측정할 수 없다고 주장했습니다.

평가

가드너의 이론은 교육 분야에서 널리 수용되었으며, 다양한 방식으로 학생들의 잠재력을 개발하는 데 초점을 맞추는 접근을 제시했습니다. 그러나 이론이 과학적 검증이 부족하다는 비판도 제기되었습니다.

3. 카텔의 유동성-결정성 지능 이론 (Cattell's Theory of Fluid and Crystallized Intelligence)

- 레이먼드 카텔(Raymond Cattell)*은 지능을 두 가지로 구분하여 설명한 이론을 제안했습니다. 그는 지능이 고정된 것이 아니라 시간에 따라 변할 수 있다고 주장했습니다.

주요 개념

- 유동성 지능 (Fluid Intelligence): 새로운 문제를 해결하고, 논리적으로 사고하며, 패턴을 인식하는 능력입니다. 유동성 지능은 주로 추론 능력과 문제 해결 능력을 포함하며, 경험이나 교육과 무관하게 발휘됩니다. 청소년기에 정점에 달한 후, 성인이 되면 점차 감소하는 경향이 있습니다.

- 결정성 지능 (Crystallized Intelligence): 경험과 교육을 통해 축적된 지식과 기술입니다. 언어 능력, 일반 상식, 문화적 지식 등이 포함되며, 나이가 들면서 증가하거나 유지되는 경향이 있습니다.

평가

카텔의 이론은 지능이 고정된 것이 아니라 시간과 경험에 따라 변화할 수 있다는 점을 강조하며, 유동성 지능과 결정성 지능이 서로 상호 보완적으로 작용한다고 봅니다. 이 이론은 특히 지능이 어떻게 발전하고 나이가 들면서 어떻게 변하는지를 설명하는 데 중요한 기여를 했습니다.

정리

- 스피어만의 지능이론은 지능을 g 요인과 s 요인으로 나누어 설명하며, 하나의 공통된 지능이 다양한 문제를 해결하는 데 기여한다고 봅니다.

- 가드너의 다중지능이론은 지능을 독립적인 여러 가지 지능으로 구분하며, 사람마다 서로 다른 지능이 발달한다고 주장합니다.

- 카텔의 유동성-결정성 지능 이론은 지능을 유동성 지능과 결정성 지능으로 나누어, 각각 다른 방식으로 발달하고 변화한다고 설명합니다.

역전파 알고리즘

- 다층 퍼셉트론(Multilayer Perceptron, MLP)*은 인공신경망(Artificial Neural Networks)의 한 형태로, 퍼셉트론이라는 기본 단위를 여러 층(layer)으로 쌓아 구성한 신경망입니다. MLP는 비선형적인 문제를 해결할 수 있는 중요한 기계 학습 모델입니다.

1. 퍼셉트론(Perceptron)

퍼셉트론은 가장 간단한 형태의 신경망으로, 하나의 뉴런에 해당합니다. 이를 통해 이진 분류 문제를 해결할 수 있으며, 퍼셉트론의 동작 원리는 다음과 같습니다.

- 입력 값(Input): 여러 입력 데이터(특징)를 받습니다.

- 가중치(Weight): 각 입력에는 가중치가 부여됩니다. 이 가중치는 학습 과정을 통해 조정되며, 입력 데이터의 중요도를 나타냅니다.

- 합산 함수(Summation Function): 입력 값과 가중치를 곱한 후 더하여 총합을 구합니다.

- 활성화 함수(Activation Function): 합산된 값이 일정 임계값을 넘으면 출력이 1, 그렇지 않으면 0을 출력합니다. 즉, 활성화 함수를 통해 이진 출력이 결정됩니다.

퍼셉트론은 단일 뉴런으로 구성된 모델로, 선형 분류 문제를 해결할 수 있습니다. 그러나 선형적으로 구분할 수 없는 문제는 해결할 수 없습니다.

2. 다층 퍼셉트론(Multilayer Perceptron, MLP)

다층 퍼셉트론은 여러 퍼셉트론을 층층이 연결한 신경망입니다. 이 구조를 통해 선형적으로 구분할 수 없는 복잡한 문제도 해결할 수 있습니다.

구조

- 입력층(Input Layer): 데이터가 처음 입력되는 층입니다. 각 입력 노드는 특성(feature)을 나타냅니다.

- 은닉층(Hidden Layer): 입력층과 출력층 사이에 위치한 층으로, 퍼셉트론이 다수 포함됩니다. 다층 퍼셉트론에서 중요한 부분은 바로 이 은닉층이며, 비선형성을 모델에 도입하는 데 중요한 역할을 합니다.

- 출력층(Output Layer): 최종 결과를 출력하는 층으로, 분류 문제에서는 클래스에 대한 예측값을 출력합니다.

비선형 활성화 함수

MLP는 단순한 퍼셉트론과 달리 비선형 활성화 함수를 사용하여 비선형적인 문제도 해결할 수 있습니다. 대표적인 활성화 함수는 다음과 같습니다:

- ReLU (Rectified Linear Unit): ReLU 함수는 입력이 양수일 때는 그대로 출력하고, 음수일 때는 0을 출력하는 함수입니다. 딥러닝에서 가장 널리 사용되는 활성화 함수입니다.

- 시그모이드(Sigmoid): 입력을 0과 1 사이의 값으로 출력합니다. 주로 이진 분류 문제에 사용됩니다.

- 소프트맥스(Softmax): 다중 클래스 분류 문제에서 확률값을 출력할 때 사용되는 활성화 함수입니다.

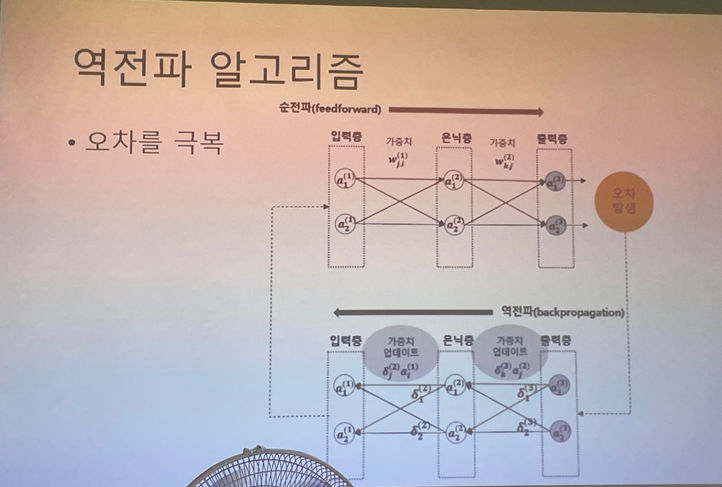

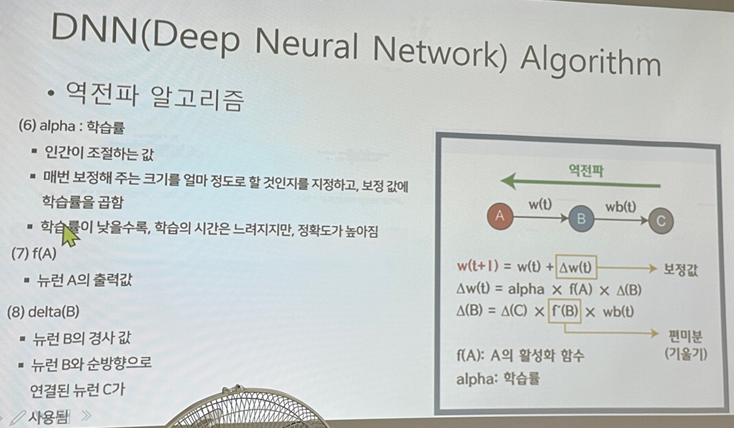

역전파 알고리즘 (Backpropagation)

다층 퍼셉트론의 학습은 역전파 알고리즘을 통해 이루어집니다. 역전파는 출력층에서 계산된 오차를 입력층 방향으로 전파하면서, 각 뉴런의 가중치를 조정하는 방법입니다.

역전파의 과정:

- 순전파(Feedforward): 입력 데이터를 입력층에서 은닉층을 거쳐 출력층까지 전달하여 예측값을 계산합니다.

- 오차 계산: 실제 값과 예측 값 간의 오차를 계산합니다.

- 역전파: 오차를 바탕으로 각 층의 가중치를 조정하는 과정을 진행합니다.

- 가중치 업데이트: 경사 하강법(Gradient Descent)을 사용해 각 가중치를 업데이트합니다.

3. 다층 퍼셉트론의 장점

- 비선형 문제 해결: 단층 퍼셉트론과 달리, 다층 퍼셉트론은 여러 은닉층과 비선형 활성화 함수를 통해 비선형적으로 구분되는 문제를 해결할 수 있습니다.

- 다양한 응용 분야: 이미지 인식, 음성 인식, 자연어 처리 등 다양한 응용 분야에서 사용될 수 있습니다.

4. 다층 퍼셉트론의 한계

- 과적합(Overfitting): 모델이 너무 복잡해지면 학습 데이터에 지나치게 맞춰져서 새로운 데이터에 대한 예측력이 떨어질 수 있습니다.

- 많은 계산 자원 요구: 깊고 복잡한 신경망을 학습하려면 많은 연산 자원과 시간이 필요합니다.

- 해석력 부족: 다층 퍼셉트론은 블랙박스 모델로, 결과를 해석하는 것이 어렵습니다.

5. MLP의 발전

다층 퍼셉트론은 기초적인 신경망 구조지만, 현재의 딥러닝 기술의 기초가 됩니다. 오늘날 심층 신경망(Deep Neural Networks)은 여러 층을 쌓아 더욱 복잡한 문제를 해결하는 데 활용됩니다. 합성곱 신경망(CNN), 순환 신경망(RNN) 등도 다층 퍼셉트론의 발전된 형태로 볼 수 있습니다.

요약: 다층 퍼셉트론은 여러 퍼셉트론을 층층이 연결하여 복잡한 비선형 문제를 해결할 수 있는 신경망입니다. 입력층, 은닉층, 출력층으로 구성되며, 비선형 활성화 함수와 역전파 알고리즘을 통해 학습합니다.

- 머신러닝(Machine Learning)*과 딥러닝(Deep Learning)은 둘 다 인공지능(AI)의 하위 분야이지만, 서로 다른 방식으로 데이터를 처리하고 학습하는 특징을 가지고 있습니다. 두 개념의 차이를 간단히 설명하면 다음과 같습니다.

1. 머신러닝(Machine Learning)

머신러닝은 컴퓨터가 명시적인 프로그래밍 없이 데이터를 통해 학습하고 예측 모델을 만드는 기술입니다. 머신러닝의 목표는 주어진 데이터를 통해 패턴을 학습하고, 그 학습된 모델을 바탕으로 새로운 데이터에 대한 예측이나 결정을 내리는 것입니다.

주요 특징

- 특성 추출(Feature Extraction): 머신러닝에서 모델을 훈련시키기 위해서는 사람이 주요 특성(Feature)을 직접 선정하고 데이터를 전처리해야 합니다. 예를 들어, 이미지 데이터에서 가장 중요한 특성은 색상, 모양, 크기 등이 될 수 있으며, 이런 특성을 사람이 미리 정의합니다.

- 알고리즘의 다양성: 머신러닝에서는 다양한 알고리즘이 사용됩니다. 예를 들어:

- 지도학습(Supervised Learning): 입력과 출력 데이터를 통해 학습하는 방식. 예) 회귀(Regression), 분류(Classification)

- 비지도학습(Unsupervised Learning): 정답 없이 데이터의 구조를 학습. 예) 클러스터링(Clustering)

- 강화학습(Reinforcement Learning): 보상을 극대화하는 방식으로 학습.

대표 알고리즘

- 결정 트리(Decision Tree)

- 랜덤 포레스트(Random Forest)

- 서포트 벡터 머신(SVM)

- k-최근접 이웃(k-NN)

- 선형 회귀(Linear Regression)

- 로지스틱 회귀(Logistic Regression)

2. 딥러닝(Deep Learning)

딥러닝은 머신러닝의 하위 분야로, 인공신경망(Artificial Neural Networks)을 기반으로 한 학습 방법입니다. 특히 다층 신경망(Deep Neural Networks)을 사용하여, 매우 복잡한 데이터에서 패턴을 자동으로 학습할 수 있는 기술입니다.

주요 특징

- 자동 특성 추출(Automatic Feature Extraction): 딥러닝 모델은 데이터를 입력받아 특성을 자동으로 학습합니다. 사람이 직접 특성을 정의하지 않고, 모델이 데이터의 복잡한 구조를 스스로 학습하며, 특히 이미지, 음성, 자연어 처리 분야에서 탁월한 성능을 보입니다.

- 다층 구조: 딥러닝은 여러 개의 은닉층(Hidden Layers)을 통해 데이터를 학습합니다. 각 층에서 데이터의 특징을 점점 더 복잡하게 추출할 수 있습니다. 이러한 층이 많아질수록 더 복잡한 문제를 해결할 수 있습니다.

신경망의 종류

- 합성곱 신경망(CNN): 주로 이미지 처리에 사용. 이미지에서 공간적 정보를 학습합니다.

- 순환 신경망(RNN): 순차적인 데이터를 처리하는 데 사용. 주로 자연어 처리(NLP)나 시계열 데이터에 적합합니다.

- 생성적 적대 신경망(GAN): 새로운 데이터를 생성하는 데 사용. 예를 들어, 사진에서 실제와 유사한 이미지를 생성하는 데 활용됩니다.

머신러닝과 딥러닝의 주요 차이점

| 특징 | 머신러닝 | 딥러닝 |

|---|---|---|

| 특성 추출(Feature Extraction) | 사람이 직접 특성을 설계해야 함 | 모델이 자동으로 특성을 학습함 |

| 데이터 처리 | 데이터가 비교적 적어도 괜찮음 | 대규모 데이터에서 더 나은 성능을 보임 |

| 학습 속도 | 비교적 빠름 | 많은 계산 자원이 필요하고, 학습 시간이 오래 걸릴 수 있음 |

| 모델의 해석력 | 알고리즘의 작동 원리가 비교적 명확하게 해석 가능 | 신경망의 작동 원리가 블랙박스(Black Box)처럼 해석이 어려움 |

| 복잡한 문제 처리 | 복잡한 데이터나 문제 처리에는 한계가 있을 수 있음 |

| 복잡한 문제나 비선형 문제를 처리할 수 있음, 특히 이미지, 음성, 텍스트 데이터에서 뛰어난 성능 |

요약

- 머신러닝은 데이터에서 패턴을 학습하는 일반적인 방법으로, 사람이 주요 특성을 정의해야 하며, 알고리즘의 종류가 다양합니다. 상대적으로 적은 데이터로도 작동하며, 학습 속도가 빠른 편입니다.

- 딥러닝은 다층 신경망을 사용하여 데이터를 자동으로 처리하고 복잡한 문제를 해결하는 방법입니다. 특히 대규모 데이터에서 뛰어난 성능을 보이며, 이미지나 음성, 자연어 처리 같은 비정형 데이터에서 매우 강력한 성능을 발휘합니다. 다만 학습에 많은 자원이 필요하고 해석이 어려울 수 있습니다.

딥러닝은 머신러닝의 한 분야로, 두 개념은 상위-하위 관계에 있다고 할 수 있습니다.